Οι παραισθήσεις τεχνητής νοημοσύνης αναφέρονται σε περιπτώσεις όπου τα μοντέλα τεχνητής νοημοσύνης, ιδιαίτερα τα μοντέλα μεγάλων γλωσσών (LLM), δημιουργούν πληροφορίες που φαίνονται αληθινές, αλλά είναι εσφαλμένες ή άσχετες με την είσοδο. Το φαινόμενο αυτό θέτει σημαντικές προκλήσεις, καθώς μπορεί να οδηγήσει στη διάδοση ψευδών ή παραπλανητικών πληροφοριών.

Αυτές οι παραισθήσεις δεν είναι τυχαία λάθη, αλλά συχνά προκύπτουν από:

- Οι πολύπλοκες αλληλεπιδράσεις των δεδομένων στα οποία εκπαιδεύετε τα μοντέλα,

- Ο σχεδιασμός του μοντέλου,

- Πώς το μοντέλο ερμηνεύει τις προτροπές.

Έτσι, η αντιμετώπιση των παραισθήσεων τεχνητής νοημοσύνης καθίσταται κρίσιμη για την αξιοπιστία και την αξιοπιστία των συστημάτων τεχνητής νοημοσύνης. Είναι απαραίτητο σε εφαρμογές όπου χρειάζεστε ακρίβεια και πραγματική ορθότητα. Ας το καταλάβουμε αυτό με περισσότερες λεπτομέρειες.

Αιτίες ψευδαισθήσεων με AI

Οι παραισθήσεις AI μπορεί να προέρχονται από διάφορους παράγοντες, όπως:

Παρερμηνείες AI λόγω ανεπαρκών δεδομένων εκπαίδευσης

Η ποιότητα, η ποικιλομορφία και η αντιπροσωπευτικότητα των δεδομένων εκπαίδευσης επηρεάζουν τον τρόπο με τον οποίο τα μοντέλα τεχνητής νοημοσύνης ερμηνεύουν και ανταποκρίνονται στις εισροές. Ανεπαρκή ή μεροληπτικά δεδομένα εκπαίδευσης μπορεί να οδηγήσουν σε μοντέλα τεχνητής νοημοσύνης που παράγουν ψευδή ή παραπλανητικά αποτελέσματα. Η επιλογή των σωστών δεδομένων εκπαίδευσης είναι απαραίτητη για να διασφαλιστεί ότι το μοντέλο έχει μια ισορροπημένη και ολοκληρωμένη κατανόηση του θέματος.

Σφάλματα μηχανικής εκμάθησης από υπερπροσαρμογή

Η υπερβολική προσαρμογή συμβαίνει όταν ένα μοντέλο AI εκπαιδεύεται σε ένα περιορισμένο σύνολο δεδομένων. Αναγκάζει το μοντέλο να απομνημονεύει συγκεκριμένες εισόδους και εξόδους αντί να μαθαίνει να γενικεύει. Αυτή η έλλειψη γενίκευσης μπορεί να προκαλέσει το μοντέλο να παράγει παραισθήσεις όταν αντιμετωπίζει νέα δεδομένα.

Σφάλματα ερμηνείας AI με ιδιωματισμούς ή αργκό

Τα μοντέλα τεχνητής νοημοσύνης μπορεί να δυσκολεύονται με ιδιωματισμούς ή εκφράσεις αργκό που δεν έχουν συναντήσει στα δεδομένα εκπαίδευσής τους. Αυτή η μη εξοικείωση μπορεί να οδηγήσει σε ανωμαλίες εξόδου AI.

Παραμορφώσεις δεδομένων AI από αντίθετες επιθέσεις

Οι αντίθετες επιθέσεις που περιλαμβάνουν προτροπές που έχουν σχεδιαστεί σκόπιμα για να παραπλανήσουν ή να μπερδέψουν την τεχνητή νοημοσύνη μπορούν να προκαλέσουν παραισθήσεις. Αυτές οι επιθέσεις εκμεταλλεύονται τα τρωτά σημεία σχεδιασμού και εκπαίδευσης του μοντέλου.

Bad Prompt Engineering

Ο τρόπος με τον οποίο δομείτε και παρουσιάζετε προτροπές σε ένα μοντέλο τεχνητής νοημοσύνης μπορεί να επηρεάσει σημαντικά τα αποτελέσματά του. Αόριστες ή διφορούμενες προτροπές μπορεί να οδηγήσουν στο μοντέλο να έχει παραισθήσεις ή να παράγει άσχετες ή εσφαλμένες πληροφορίες. Αντίθετα, καλά κατασκευασμένα μηνύματα που παρέχουν σαφές πλαίσιο και κατεύθυνση μπορούν να καθοδηγήσουν το μοντέλο ώστε να δημιουργήσει πιο ακριβείς και σχετικές απαντήσεις.

Τεχνικές για τη μείωση των ψευδαισθήσεων με AI

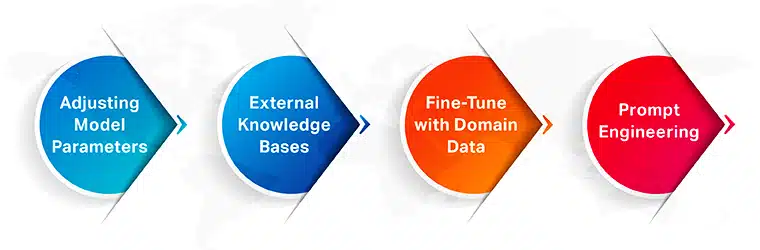

Η μείωση των παραισθήσεων σε μοντέλα τεχνητής νοημοσύνης, ιδιαίτερα μεγάλα γλωσσικά μοντέλα, περιλαμβάνει έναν συνδυασμό τεχνικών στρατηγικών:

Προσαρμογή παραμέτρων μοντέλου

Η ρύθμιση της παραμέτρου θερμοκρασίας στο 0 μπορεί να δώσει πιο ακριβή αποτελέσματα. Η θερμοκρασία ελέγχει την τυχαιότητα στη δημιουργία απόκρισης του μοντέλου. Μια χαμηλότερη θερμοκρασία σημαίνει ότι το μοντέλο μπορεί να επιλέξει τις πιο πιθανές λέξεις και φράσεις για πιο προβλέψιμα και αξιόπιστα αποτελέσματα. Αυτή η προσαρμογή είναι ιδιαίτερα πολύτιμη για εργασίες που απαιτούν πραγματική ακρίβεια και συνέπεια.

Εξωτερικές Γνωσιακές Βάσεις

Η χρήση εξωτερικών πηγών δεδομένων για επαλήθευση μπορεί να μειώσει σημαντικά τα σφάλματα παραγωγής. Μπορεί να αναφέρει αυτά τα εξωτερικά δεδομένα κατά τη δημιουργία αποκρίσεων παρέχοντας στο μοντέλο ενημερωμένες και επαληθευμένες πληροφορίες. Αυτή η προσέγγιση μετατρέπει το καθαρά γενετικό πρόβλημα σε μια πιο απλή εργασία αναζήτησης ή σύνοψης που βασίζεται στα παρεχόμενα δεδομένα.

Εργαλεία όπως το Perplexity.ai και το You.com επιδεικνύουν την αποτελεσματικότητα αυτής της μεθόδου συνθέτοντας εξόδους LLM με ποικίλα δεδομένα ανακτάται από εξωτερικές πηγές.

Βελτιστοποίηση με Δεδομένα Ειδικά για Τομέα

Τα μοντέλα εκπαίδευσης με δεδομένα για συγκεκριμένο τομέα ενισχύουν την ακρίβειά τους και μειώνουν τις παραισθήσεις. Αυτή η διαδικασία εκθέτει το μοντέλο σε μοτίβα και παραδείγματα σχετικά με ένα συγκεκριμένο πεδίο ή θέμα. Με αυτόν τον τρόπο, μπορείτε να ευθυγραμμίσετε τις εξόδους του με τον τομέα προορισμού.

Αυτή η λεπτή ρύθμιση επιτρέπει στο μοντέλο να παράγει πιο κατάλληλες και ακριβείς απαντήσεις με βάση τα συμφραζόμενα. Είναι απαραίτητο σε εξειδικευμένες εφαρμογές όπως η ιατρική, η νομική ή η χρηματοδότηση.

Άμεση Μηχανική

Ο σχεδιασμός των προτροπών παίζει βασικό ρόλο στον μετριασμό των παραισθήσεων. Σαφείς, πλούσιες σε περιβάλλον προτροπές καθοδηγούν το μοντέλο AI πιο αποτελεσματικά. Μπορούν να μειώσουν τις παρανοήσεις και τις ασάφειες της τεχνητής νοημοσύνης και να κατευθύνουν το μοντέλο προς τη δημιουργία σχετικών και ακριβών απαντήσεων.

Το μοντέλο σας είναι λιγότερο πιθανό να παράγει άσχετα ή εσφαλμένα αποτελέσματα εάν προσδιορίσετε με σαφήνεια τις ανάγκες πληροφοριών και παρέχετε το απαραίτητο πλαίσιο.

Προηγμένες στρατηγικές για τον μετριασμό των ψευδαισθήσεων

Μπορείτε να αξιοποιήσετε τρεις προηγμένες μεθόδους για να μειώσετε τις παραισθήσεις AI σε μεγάλα γλωσσικά μοντέλα, οι οποίες περιλαμβάνουν:

Ανάκτηση-αυξημένη γενιά (RAG)

Αυτή η μέθοδος συνδυάζει τις δυνατότητες δημιουργίας των LLM με μια διανυσματική βάση δεδομένων που λειτουργεί ως βάση γνώσεων. Όταν εισάγεται ένα ερώτημα, το μοντέλο το μετατρέπει σε σημασιολογικό διάνυσμα και ανακτά έγγραφα με παρόμοια διανύσματα.

Στη συνέχεια, το LLM χρησιμοποιεί αυτά τα έγγραφα και το αρχικό ερώτημα για να δημιουργήσει μια πιο ακριβή και σχετική με τα συμφραζόμενα απάντηση. Το RAG ουσιαστικά εξοπλίζει το LLM με μια μορφή μακροχρόνια μνήμη. Αυτό επιτρέπει στο LLM να έχει πρόσβαση και να ενσωματώνει εξωτερικά δεδομένα.

Συλλογισμός με προτροπή αλυσίδας σκέψης

Τα LLM υπερέχουν σε εργασίες όπως η πρόβλεψη λέξεων, η σύνοψη πληροφοριών και η εξαγωγή δεδομένων λόγω της προόδου στους μετασχηματιστές. Μπορούν επίσης να συμμετάσχουν σε προγραμματισμό και σύνθετη συλλογιστική.

Η προτροπή αλυσίδας σκέψης βοηθά τους LLM να αναλύουν τα προβλήματα πολλαπλών βημάτων σε πιο διαχειρίσιμα βήματα. Βελτιώνει την ικανότητά τους να επιλύουν σύνθετες συλλογιστικές εργασίες. Αυτή η μέθοδος ενισχύεται με την ενσωμάτωση παραδειγμάτων από μια διανυσματική βάση δεδομένων, η οποία παρέχει πρόσθετο πλαίσιο και παραδείγματα για να αξιοποιήσει το LLM. Οι απαντήσεις που προκύπτουν είναι ακριβείς και περιλαμβάνουν το σκεπτικό πίσω από αυτές, που αποθηκεύονται περαιτέρω στη διανυσματική βάση δεδομένων για τη βελτίωση των μελλοντικών απαντήσεων.

Επαναληπτική Ερώτηση

Αυτή η διαδικασία περιλαμβάνει έναν πράκτορα AI που διευκολύνει τις επαναληπτικές αλληλεπιδράσεις μεταξύ του LLM και μιας διανυσματικής βάσης δεδομένων. Ο πράκτορας ερωτά τη βάση δεδομένων με μια ερώτηση, βελτιώνει την αναζήτηση με βάση παρόμοιες ερωτήσεις που ανακτήθηκαν και στη συνέχεια συνοψίζει τις απαντήσεις.

Εάν η συνοπτική απάντηση δεν είναι ικανοποιητική, η διαδικασία επαναλαμβάνεται. Αυτή η μέθοδος, που αποτελεί παράδειγμα της Forward-Looking Active Retrieval Generation (FLARE), βελτιώνει την ποιότητα της τελικής απάντησης βελτιώνοντας σταδιακά το ερώτημα και την απόκριση μέσω πολλαπλών επαναλήψεων.

Συμπέρασμα

Η υπέρβαση των παραισθήσεων σε μοντέλα AI απαιτεί μια πολύπλευρη προσέγγιση. Πρέπει να συνδυάζει τεχνικές προσαρμογές με προηγμένες στρατηγικές συλλογιστικής. Η ενσωμάτωση μεθόδων μετριασμού μπορεί να βελτιώσει σημαντικά την ακρίβεια και την αξιοπιστία των απαντήσεων AI. Αυτές οι στρατηγικές αντιμετωπίζουν τα άμεσα ζητήματα των παραισθήσεων τεχνητής νοημοσύνης και ανοίγουν το δρόμο για πιο ισχυρά και αξιόπιστα συστήματα τεχνητής νοημοσύνης στο μέλλον.